fb指引曝光 自殘暴力可保留

23/05/2017

全球最大社交網站Facebook(fb)的內部指引曝光,對暴力、仇恨、恐怖主義、色情和自殘等內容的去留均有所規定,但部分項目可能存在商榷,甚至爭議之處。

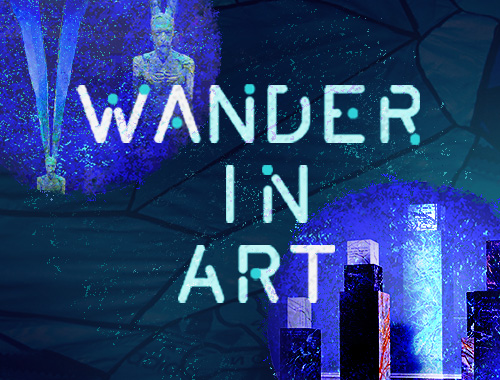

Facebook的內部指引曝光,對暴力、仇恨、恐怖主義、色情和自殘等內容的去留均有所規定,但仍存在爭議。 (CNS資料圖片)

英國《衞報》取得fb內部超過100份指引作出今次報道,而當中向員工指出哪些的內容,可以在fb出現,哪些不可以。

員工:判斷內容政策不貫徹

fb員工消息向該報埋怨,fb判斷內容的政策不貫徹(inconsistent)且怪異(peculiar)。

例如自殘直播,指引稱是容許存在,因為不希望對有壓力而企圖自殺的人作出懲罰或審查。

至於暴力致死的影片,也不一定會被刪除,因為指引指出,這是有助大眾關注精神病等的社會議題。

當涉及恐嚇內容,例如「槍擊(美國總統)特朗普」,必須被刪除,因為國家元首屬受保護項目;但「把某潑婦割喉殺死」,則毋須刪除,因為不構成實質威脅。

用戶增長太快 審查工作超負荷

另一方面,fb環球政策管理部門主管比克特(Monika Bickert)回應《衞報》查詢,表示fb向近20億用戶提供服務,各人對於甚麼內容適合分享,往往有不同看法,很難達到共識。

比克特其後發表聲明,重申確保fb用戶安全是首要考慮因素,並會盡可能保障言論自由。

fb目前聘有4,500名員工,負責審查有關內容,並在早前宣布增聘多3,000人。

報道引述fb員工消息指出,由於fb用戶增長速度太快,用戶數量太多。

10秒內判斷 難控制內容

審查人員的工作嚴重超出負荷,僅得10秒對內容作判斷,形容fb已無法控制其內容。

另有文件顯示,fb每周需要檢視超過650萬個懷疑虛假帳戶,再加上「報復式色情」(revenge porn)等新挑戰,均令員工疲於奔命。

摘錄自香港經濟日報

【與拍賣官看藝術】常玉作品屢創天價,背後其實藏著跌宕起伏的人生► 即睇